تعمل شبكات GPU اللامركزية على الترويج لنفسها كطبقة منخفضة التكلفة لتشغيل أعباء عمل الذكاء الاصطناعي، في حين يظل تدريب أحدث النماذج مركّزًا داخل مراكز البيانات واسعة النطاق.

يتضمن تدريب Frontier AI بناء أكبر الأنظمة وأكثرها تقدمًا، وهي عملية تتطلب الآلاف من وحدات معالجة الرسومات للعمل في تزامن محكم.

هذا المستوى من التنسيق يجعل الشبكات اللامركزية غير عملية للتدريب المتطور على الذكاء الاصطناعي، حيث لا يمكن لزمن وصول الإنترنت وموثوقيته أن يتطابق مع الأجهزة المقترنة بإحكام في مراكز البيانات المركزية.

لا تشبه معظم أعباء عمل الذكاء الاصطناعي في الإنتاج التدريب على النماذج واسعة النطاق، مما يفتح مساحة للشبكات اللامركزية للتعامل مع الاستدلال والمهام اليومية.

وقال ميتش ليو، المؤسس المشارك والرئيس التنفيذي لشبكة ثيتا، لكوينتيليغراف: “ما بدأنا نراه هو أن العديد من النماذج مفتوحة المصدر وغيرها من النماذج أصبحت مدمجة بما فيه الكفاية ومُحسَّنة بما يكفي للعمل بكفاءة عالية على وحدات معالجة الرسوميات الاستهلاكية”. “هذا يخلق تحولا نحو نماذج مفتوحة المصدر وأكثر كفاءة وأساليب معالجة أكثر اقتصادا.”

من تدريب الذكاء الاصطناعي الحدودي إلى الاستدلال اليومي

يتركز التدريب الحدودي بين عدد قليل من المشغلين على نطاق واسع، حيث أن إدارة وظائف التدريب الكبيرة مكلفة ومعقدة. تم تصميم أحدث أجهزة الذكاء الاصطناعي، مثل Vera Rubin من Nvidia، لتحسين الأداء داخل بيئات مراكز البيانات المتكاملة.

قال نوكفي دان إليداسون، الرئيس التنفيذي لشركة البنية التحتية Ovia Systems (Gaimin سابقًا)، لكوينتيليغراف: “يمكنك التفكير في التدريب على نماذج الذكاء الاصطناعي الحدودية مثل بناء ناطحة سحاب”. “في مركز البيانات المركزي، يكون جميع العمال على نفس السقالة، ويمررون الطوب بأيديهم.”

ولا يترك هذا المستوى من التكامل مجالًا كبيرًا للتنسيق الفضفاض وزمن الاستجابة المتغير النموذجي للشبكات الموزعة.

وتابع إليداسون: “لبناء ناطحة السحاب نفسها (في شبكة لا مركزية)، يتعين عليهم إرسال كل قطعة من الطوب إلى بعضهم البعض عبر الإنترنت المفتوح، وهو أمر غير فعال إلى حد كبير”.

قامت Meta بتدريب نموذج Llama 4 AI الخاص بها باستخدام مجموعة تضم أكثر من 100000 وحدة معالجة رسوميات Nvidia H100. لا تكشف OpenAI عن حجم مجموعات وحدات معالجة الرسومات المستخدمة لتدريب نماذجها، لكن رئيس البنية التحتية Anuj Saharan قال إن GPT-5 تم إطلاقه بدعم من أكثر من 200000 وحدة معالجة رسومات، دون تحديد مقدار هذه السعة المستخدمة للتدريب مقابل الاستدلال أو أعباء العمل الأخرى.

يشير الاستدلال إلى تشغيل النماذج المدربة لتوليد استجابات للمستخدمين والتطبيقات. وقال إليداسون إن سوق الذكاء الاصطناعي وصل إلى “نقطة تحول في الاستدلال”. في حين أن التدريب سيطر على الطلب على وحدات معالجة الرسومات حتى عام 2024، فقد قدر أن ما يصل إلى 70% من الطلب مدفوع بالاستدلال والوكلاء وأعباء عمل التنبؤ في عام 2026.

وقال إليداسون: “لقد أدى هذا إلى تحويل الحوسبة من تكلفة بحث إلى تكلفة مرافق مستمرة ومتوسعة”. “وبالتالي، فإن مضاعفة الطلب من خلال الحلقات الداخلية تجعل الحوسبة اللامركزية خيارًا قابلاً للتطبيق في محادثة الحوسبة المختلطة.”

متعلق ب: لماذا لم تتمكن البنية التحتية للعملات المشفرة من اللحاق بمثلها العليا؟

حيث تناسب شبكات GPU اللامركزية بالفعل

تعد شبكات GPU اللامركزية مناسبة بشكل أفضل لأحمال العمل التي يمكن تقسيمها وتوجيهها وتنفيذها بشكل مستقل، دون الحاجة إلى مزامنة مستمرة بين الأجهزة.

قال إيفجيني بونوماريف، المؤسس المشارك لمنصة الحوسبة اللامركزية فلوينس، لكوينتيليغراف: “إن الاستدلال هو حجم الأعمال، وهو يتوسع مع كل نموذج منشور وحلقة وكيل”. “هذا هو المكان الذي تكون فيه التكلفة والمرونة والانتشار الجغرافي أكثر أهمية من الترابط المثالي.”

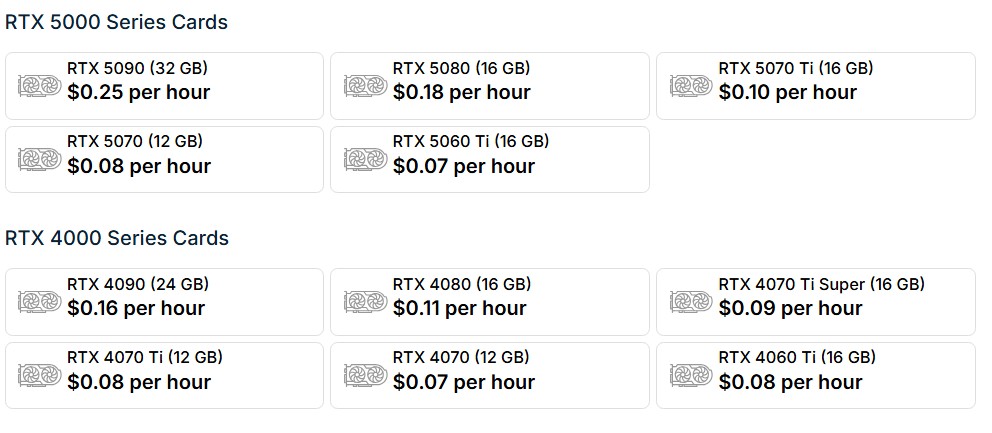

ومن الناحية العملية، فإن ذلك يجعل وحدات معالجة الرسوميات اللامركزية ووحدات معالجة الرسومات المخصصة للألعاب في البيئات الاستهلاكية أكثر ملاءمةً لأحمال عمل الإنتاج التي تعطي الأولوية للإنتاجية والمرونة على التنسيق المحكم.

قال بوب مايلز، الرئيس التنفيذي لشركة Salad Technologies – وهي شركة مجمعة لوحدات معالجة الرسومات الاستهلاكية الخاملة – لكوينتيليغراف: “إن وحدات معالجة الرسومات الاستهلاكية، ذات ذاكرة VRAM المنخفضة واتصالات الإنترنت المنزلية، لا معنى لها للتدريب أو أعباء العمل شديدة الحساسية لزمن الوصول”.

“اليوم، أصبحت أكثر ملاءمة لاكتشاف أدوية الذكاء الاصطناعي، وتحويل النص إلى صورة/فيديو، وخطوط أنابيب معالجة البيانات واسعة النطاق – أي عبء عمل حساس من حيث التكلفة، وتتفوق وحدات معالجة الرسومات الاستهلاكية في أداء السعر.”

تعد شبكات GPU اللامركزية أيضًا مناسبة تمامًا لمهام مثل جمع البيانات وتنظيفها وإعدادها للتدريب النموذجي. غالبًا ما تتطلب مثل هذه المهام وصولاً واسع النطاق إلى شبكة الويب المفتوحة ويمكن تنفيذها بالتوازي دون تنسيق وثيق.

وقال مايلز إن هذا النوع من العمل يصعب تشغيله بكفاءة داخل مراكز البيانات واسعة النطاق دون وجود بنية تحتية وكيلة واسعة النطاق.

عند خدمة المستخدمين في جميع أنحاء العالم، يمكن أن يتمتع النموذج اللامركزي بميزة جغرافية، حيث يمكنه تقليل المسافات التي يتعين على الطلبات قطعها والقفزات المتعددة للشبكة قبل الوصول إلى مركز البيانات، مما قد يؤدي إلى زيادة زمن الوصول.

“في النموذج اللامركزي، يتم توزيع وحدات معالجة الرسومات عبر العديد من المواقع على مستوى العالم، وغالبًا ما تكون أقرب إلى المستخدمين النهائيين. ونتيجة لذلك، يمكن أن يكون زمن الوصول بين المستخدم ووحدة معالجة الرسومات أقل بكثير مقارنة بتوجيه حركة المرور إلى مركز بيانات مركزي،” قال ليو من شبكة Theta Network.

تواجه شبكة Theta دعوى قضائية مرفوعة في لوس أنجلوس في ديسمبر 2025 من قبل اثنين من الموظفين السابقين يزعمون فيها الاحتيال والتلاعب بالرموز. وقال ليو إنه لا يستطيع التعليق على الأمر لأنه في انتظار التقاضي. وقد نفت ثيتا في السابق هذه المزاعم.

متعلق ب: كيف سيؤدي تداول العملات المشفرة باستخدام الذكاء الاصطناعي إلى إنشاء الأدوار البشرية وكسرها

طبقة تكميلية في حوسبة الذكاء الاصطناعي

سيظل تدريب Frontier AI مركزيًا في المستقبل المنظور، لكن حوسبة الذكاء الاصطناعي تتحول بعيدًا إلى الاستدلال والوكلاء وأعباء عمل الإنتاج التي تتطلب تنسيقًا أكثر مرونة. وتكافئ أعباء العمل هذه كفاءة التكلفة والتوزيع الجغرافي والمرونة.

“شهدت هذه الدورة ظهور العديد من النماذج مفتوحة المصدر التي ليست على مستوى أنظمة مثل ChatGPT، ولكنها لا تزال قادرة بما يكفي للتشغيل على أجهزة الكمبيوتر الشخصية المجهزة بوحدات معالجة الرسومات مثل RTX 4090 أو 5090،” صرح جيي لونج، المؤسس المشارك لشركة Liu ورئيس التكنولوجيا في Theta، لكوينتيليغراف.

باستخدام هذا المستوى من الأجهزة، يمكن للمستخدمين تشغيل نماذج الانتشار ونماذج إعادة البناء ثلاثية الأبعاد وأحمال العمل الأخرى ذات المغزى محليًا، مما يخلق فرصة لمستخدمي التجزئة لمشاركة موارد وحدة معالجة الرسومات الخاصة بهم، وفقًا لما ذكره لونج.

لا تعد شبكات GPU اللامركزية بديلاً عن أدوات التوسعة الفائقة، ولكنها أصبحت طبقة تكميلية.

مع زيادة قدرة الأجهزة الاستهلاكية وزيادة كفاءة النماذج مفتوحة المصدر، يمكن لفئة واسعة من مهام الذكاء الاصطناعي أن تنتقل خارج مراكز البيانات المركزية، مما يسمح للنماذج اللامركزية بالتناسب مع مجموعة الذكاء الاصطناعي.

مجلة: أغرب 6 أجهزة استخدمها الناس لتعدين البيتكوين والعملات المشفرة